谁在「吊打」ChatGPT?

AI行业的“百模大战”已经打了大半年。从上半年的火热,到下半年的渐冷,胜负难分。

GPT成了国内厂商的靶子。几乎每家在发布大模型时,都要把GPT拉出来对比一波,而且他们总能找到一个指标把GPT超越——比如,中文能力。

测评类的榜单太多了。从英文的MMLU,到中文的SuperCLUE,再到借鉴游戏排位赛机制的ChatbotArena,各种大模型榜单让人眼花缭乱。很多时候,榜单上的排名成为厂商对外宣传的工具。

但奇怪的是,用户在体验后发现,号称超越ChatGPT的一些大模型产品,实际表现不尽如人意。各种不同的统计排名口径,更是让人感到迷惑。以至于“*”太多,榜单都快不够用了。

比如最近,昆仑万维开源「天工」系列大模型,号称多榜超越Llama 2;李开复的零一万物公司发布开源大模型“Yi”,“*”全球多项榜单;vivo发布自研AI“蓝心”大模型,是国内“首家”开源7B大模型的手机厂商。

如此之多的大模型,跑马圈地这半年,大家做得怎么样?我们又该如何评价孰优孰劣?

1、“刷榜”,大模型公开的秘密

就像当年手机厂商流行跑分打榜,现在的大模型厂商,也热衷于冲上各种榜单。

大模型相关的榜单很多,学术圈、产业界、媒体智库、开源社区,都在今年推出了各种各样的评测榜单。这其中,国内厂商常常引用的是SuperCLUE和C-Eval,这俩都由国人自己推出。

5月6日科大讯飞发布星火认知大模型,三天后SuperCLUE发布榜单,星火排在国产*;6月13日360集团发布360智脑大模型,六天后SuperCLUE更新榜单,360成了*。

再后来的7月、8月、9月、10月榜单,拿下国产*的分别是百度、百川智能、商汤、vivo。“登顶”“夺冠”“国内*”,出现在这些厂商的宣传中。

当时,SuperCLUE只用了几百道题进行测试,被人质疑不够客观。而在国外,早就有一个叫做SuperGLUE的权威榜单,二者名称相似度极高,让人傻傻分不清楚。后来,SuperCLUE对测评标准和题目数量进行了完善,日渐成为国内知名度较高的测评榜。

大模型测评领域的业内人士赵小跃对「定焦」说,一些测评机构有题库,用接入各家厂商API的方式来测试,但其实测一遍之后,厂商就知道测过什么题,除非下轮测试换题,否则厂商可以用定向爆破的方式得高分。

在他看来,一套题只要测过一家模型,题目就废了,因为模型可以通过API获取题目,题目的可重复性为零。这是模型评测最有挑战的一件事情。

C-Eval榜单刚推出时,业内是认可的。它由上海交通大学、清华大学、爱丁堡大学共同完成,有13948道题目。

但很快,大家就发现,一些原本知名度不高的大模型,突然冲到了榜首,甚至把GPT4踩在脚下使劲摩擦。

在9月初的榜单中,云天励飞大模型总分排*,360排第八,GPT4居然排第十。再后来,拿过榜单*的还有度小满金融大模型、作业帮银河大模型,业内公认最强的GPT4被它们无情甩在了身后。

成绩垫底,到底是GPT错了还是榜错了?

显然,榜单有问题,因为它遭遇了“不健康的刷榜”。

这三种方法,前两种可以视为间接作弊,第三种相当于直接作弊。

大模型从业者李健对「定焦」说,间接作弊,就是知道考试大概的类型,然后花较多精力把可能的题目都找出来或叫专业的人造出来,答案也给出来,用这样的数据训练模型。

他指出,业内现在常用的手段是,让GPT4来“造答案”,然后得到训练数据。

李健分析,直接作弊,就是知道考试题目,然后稍微改改,得到新的很多份题目,之后直接拿来训练模型。

“在清楚榜单任务的情况下,很多类型的任务,很容易刷榜。”他说。

这样得到的分数是没有意义的。“直接作弊基本对提升模型的泛化能力没用,间接作弊有点像做题家,对提升学生真实的素质弊大于利。”

为了让“用户谨慎看待以下榜单”,C-Eval团队不得不将榜单拆分成两个,一个是模型已公开的,一个是未公开的。结果,那些得分高的基本全是未公开的大模型。而这些模型的真实表现,人们是无法体验的。

复旦大学计算机科学技术学院教授邱锡鹏说,C-Eval本身质量还挺高,但被刷榜后导致学术价值不大了。现在很多企业去刷榜,但又不公开数据,也不具体说怎么做,这是一种不公平的竞争。

多位大模型从业者对「定焦」说,刷榜在大模型行业很常见。

跃盟科技创始人王冉对「定焦」打了一个比方:“先射完箭再画靶子”。他认为今天的某些测评手段,是有一些大模型公司为了表现自己牛而专门设计的。

盛景嘉成董事总经理刘迪认为,有答案或者评分标准,就有人能钻空子。单靠数据集和问题集的评判方式,很难评出大模型在应用层面的好坏。

“一个丹一个炼法,哪个对症还得吃下去看。”他对「定焦」说。

2、考试拿*,不是好学生?

大模型评测,作为评估大模型综合实力的一个手段,还有参考价值吗?

赵小跃认为,在核心的通用能力上,比如语言理解、逻辑推理等,学术数据集的榜单测评能反映七八成。这其中*的问题是,开源的榜单结果跟大家用大语言模型的场景之间有鸿沟。

“测评只能反映模型某一部分的能力,大家其实都是从不同的维度盲人摸象,很难知道它的能力边界在哪里。”他说。

对于大语言模型,首先在语言上,分为英文和中文两大语种。国外大模型的训练语料以英文为主,所以英文很强,但中文不一定比国内大模型强。这也是为什么国内很多大模型,都在“超越ChatGPT”之前加一个“中文能力”的定语。

其次在考察科目上,评测数据集通常会设置很多个方面,从百科知识到角色扮演,从上下文对话到闲聊。但这些能力只能单一评价,然后得分加总。

这跟评价一个人很像。任何一道考卷,都只能测试出这个人某方面的能力。即便是全套试卷的成绩,也不等同于这个人的能力。就像ChatGPT的榜单排名不一定能比过国内的一些大模型,但使用体验上就是更好。

王冉认为,如果将大模型比作一个人的大脑,如何评测一个人的大脑好用,如果只给他做题,其实是充满偏见的。“大模型的测评不应该用考试来做,而应该用应用来做。”

人工智能公司开放传神创始人、CEO陈冉认为,通用性的评测,看综合得分,没有一个大模型超过GPT4,但是在特定领域,可能有些指标GPT4得分不一定高。

问题在于,有些厂商拿特定领域的得分,去宣传整体超过了GPT4。“这就是以偏概全,我觉得有些厂商在对外宣传时,还是要对生态公司给到正确的指引,具体哪个指标在哪个领域得分高,要说清楚。”他对「定焦」表示。

而一旦测评成绩进入排名赛,有了功利的成分,有些厂商就会有刷榜的动机。“从刷榜的角度,不太能保证中小厂不会把这部分数据拿去训练,这是大家对公开数据集*的顾虑。”赵小跃说。

综合多位业内人士的观点,目前国内还没有一个特别好的数据集,能综合反映大模型的能力,各方都在探索。

李健在今年做了“CLiB中文大模型能力评测榜单”,为了避免泄题,他尽量参考业界好的方案,自己出题。“主要是业界和学术界的榜单,不太让人满意,公开程度不高,都是各说各话。”

还有一些非商业性质的机构相信,测评榜单*的意义在于,从模型演化的角度,能够帮助厂商监控模型生产过程中能力的变化,纠正训练模型的方法,有针对性提高模型能力。

比如OpenCompass,它是Meta官方推荐的开源大模型评测框架,利用分布式技术支持上百个数据集的评测,提供了大模型评测的所有技术细节,同时给大家提供了统一的测试基准,方便各家模型在公平公正的情况下开展对比。

3、开源:先赚吆喝再赚钱

对大模型做出全面评价是困难的。除了打榜的方式,有一些厂商通过开源,获得了巨大的关注。

开源是一种经营策略,需要对自家产品足够自信。相比之下,敢于放开注册让公众体验的闭源大模型,要比那些无法体验的强,开源大模型则又往前迈了一步。

*个被大范围使用、好评度最高的开源大语言模型,是由Meta在今年2月推出的Llama。当时全球科技公司都盯着OpenAI,试图追赶闭源的ChatGPT。但开源让Meta坐上了牌桌,吸引了大量开发者,一时名声大噪。

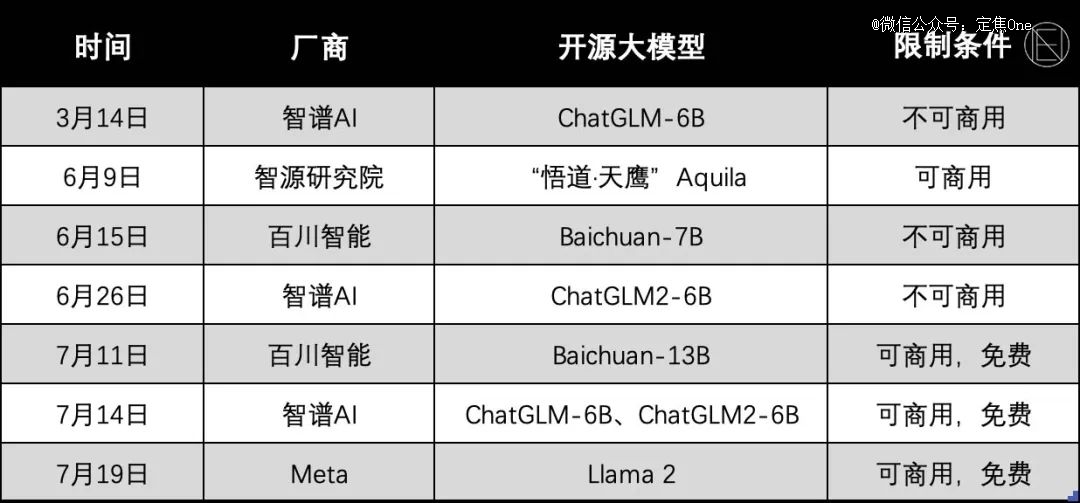

国内公司很快跟上,抢抓*波关注度。智谱AI、智源研究院、百川智能,是动作最快的三家。

在Llama开源之后,号称全面对标OpenAI、有着清华背景的智谱AI,迅速在国内*个开源了自己的大模型ChatGLM-6B。这个时间点非常早,当时国内厂商的大模型都还没发布,百度文心一言两天后才推出,而王小川的百川智能公司还没成立。

三个月后的6月9日,跟智谱AI有着很深渊源的智源研究院,宣布开源“悟道·天鹰”Aquila。它比智谱AI更进一步——可商用,于是拿下“国内*开源可商用语言大模型”的头衔。

是否支持商用,是判断模型能力的一个关键指标。GPT 3.5的水平,通常被认为是大模型商用的标准线。不过,智源是一个非营利机构,它更多的用意是为公用发展提供技术支持。

智源主动开源之后,开源大模型的军备竞赛正式打响。

这其中值得一提的是百川智能。作为一家今年4月才成立的初创公司,百川获得的关注度甚至超过很多互联网大厂。

从时间上来看,百川是智源之后*家开源的创业公司,且*个宣布可免费商用。它开源不可商用的版本时,比智谱AI早九天;后来开源免费可商用的版本时,又比智谱AI早三天。

时间点很重要。当时Llama1只被允许用作研究,但市场有传闻可商用的Llama 2即将开源。百川不仅抢在Llama 2之前,还卡在智谱AI之前宣布了免费可商用,赢得了巨大的关注度,一周之内下载量破百万。

赵小跃认为,百川在那个时间发布一个开源模型,作为自己的*枪,是一个很对的决策。“赚了一波吆喝。”

支持商用的Llama 2比百川和智谱AI晚了一周,即便如此,它还是在全球引发巨震。在同等参数规模下,Llama 2能力超过所有的开源大模型,是目前全球公认的开源大模型的代表。

因为Llama的带动,国内厂商踩上了开源热潮的风口。它们急着秀肌肉,争夺大众注意力。但从技术角度,尚不能说明它们就跑在了前面。

有观点认为,开源模型虽多,但大多数都是从Llama派生出来。简单来说,就是用了Llama作为基模型,然后选用其它不同的训练方法微调。因为Llama原生在中文方面相对较弱,给了国产开源大模型宣传的发力点。

6月中旬百川开源*版Baichuan-7B时,公司只成立刚两个月。当时有人质疑其模型架构跟Llama很相似。“借助已经开源的技术和方案,百川是站在了巨人的肩膀上。”一位大模型创业者评价。

本质上,开源也是一种商业模式。赚完吆喝后,厂商的目的还是赚钱。

陈冉向「定焦」举了个例子,开源就像一些化妆品品牌推出试用装,免费给用户用,但不会透露配方和成分。用户试用完如果觉得好想继续用,就得付费买商业版。另外它可能透露配方,如果有厂商想基于这个配方去创造一个新的产品,就需要交授权费。

百川在9月下旬推出了两款闭源大模型,API接口对外开放,进入ToB领域,开启商业化进程。

“它已经通过开源赚了一波吆喝,接下来一定会推闭源大模型做商业化,它*进的模型是一定不会开源的。”赵小跃说。

4、大家都没有护城河?

“百模大战”发展到今天,各家厂商通过各种方式博取关注度,那么谁做到了真正的*?

赵小跃认为,从主观感受层面来看,国内的大模型,无论是开源还是闭源,本质上没有核心的技术代差。因为无论是模型大小,还是数据质量,大家都没有飞跃式的突破。“在GPT3.5的指引下,国内厂商只要模型容量达到一定地步,再配合一批高质量数据,大家都不会太差。”

但跟GPT4相比,技术代差是存在的。“因为闭源,大家不知道GPT4背后真正的技术方案是什么,如何把这么大的模型用专家结构训练出来,目前大家还都在探索。”

在陈冉看来,国内的大语言模型完全原创的较少,有些是在transformer架构上做了一个整体调优,本质是在算子上做了调优,而没有本质上的改变。还有一些走开源路线的厂商,更多是在中文方面深入研究。

大家都有自己的大模型,但本质上没有显著的区别,这就是当前国内大模型行业的特点。

某种程度上,这是由行业阶段决定的。国内的互联网大厂、创业公司、高校科研机构,真正开始投入大量人力物力做大模型,也就在今年。行业的技术路线也还在摸索中,没有哪家公司建立起护城河。

相比纯技术实力方面的比拼,算力和数据层面的比拼更能出效果。

“大家更多的精力是花在数据和语料上,谁能花钱获得高质量的语料,同时有足够的算力,谁就能训练出一个相对好一点的模型。”陈冉说。

开源让局面变得更加不可控。去年底ChatGPT亮相后,全球冒出来上百个大模型,但今年Meta开源Llama 2之后,很多模型还没有投入市场就已经过时。就连谷歌的工程师都在内部直言称,谷歌和OpenAI都没有护城河。

大模型更新迭代太快了。“今天你推出一个大模型,花钱打了榜,有很多人用,可能明天就有个新的模型迅速替代掉。”陈冉说。

多位业内人士对「定焦」表示,大模型之间真正显著的区别,会在具体的用户场景或B端的业务中体现。

“现实世界里我们评价某个人是专家,是因为他在特定领域很厉害。大模型也一样,要在领域里建立共识,专业性一定要放到具体的场景里去体现。”王冉说。

核心的通用能力是基础,厂商会根据自己所在的领域,差异化发展。“比如我们跟医院和律所接触,他们其实更关心的是医疗或法律方面的能力。”赵小跃说。

对于互联网巨头而言,需要考量的因素相对更多。

除了要对外“接单”,巨头们已经开始在内部进行大模型的应用端部署。比如腾讯的广告、游戏、社交、会议等业务,接入了混元大模型,百度搜索、文库、百家号等产品早已接入文心大模型,阿里把AI作为各大业务板块的驱动力。

大模型对巨头内部的正面影响究竟有多大,会更难量化评估。

综合来看,国内大模型还处在起跑的混沌阶段,一切都在快速变化中。做出一个大模型的技术壁垒不高,但要做好并真的解决问题,还有很长的路要走。

热门新闻

最新文章